Yapay Zekâda Kartlar Yeniden Dağıtılıyor: Türkiye İçin Bir Fırsat Penceresi

Yapay zekâ dünyasında büyük bir kırılma yaşanıyor. Çin merkezli DeepSeek, ABD’nin teknoloji devleri tarafından geliştirilen büyük dil modellerine meydan okuyarak, daha düşük maliyetli, daha az enerji tüketen ve süper bilgisayar gerektirmeyen bir yapay zekâ modeli sundu. Üstelik, bu modeli tamamen açık kaynak olarak herkesin erişimine açtı. Bu gelişme, ABD merkezli yapay zekâ şirketlerinin hakimiyetinin sarsılmasına yol açarken, gelişmekte olan ülkeler için yapay zekâ geliştirme süreçlerinin demokratikleşmesini sağladı.

- 10 Şubat 2025 09:26

Akademisyen Dr. Ezgi Avcı

Yıllardır yüksek maliyetler, donanım bağımlılığı ve büyük veri gereksinimleri nedeniyle yapay zekâ yarışına tam anlamıyla katılamayan ülkeler için yeni bir fırsat penceresi açılmış durumda. Türkiye de bu fırsatı değerlendirebilecek ülkeler arasında yer alıyor. Eğer DeepSeek gibi açık kaynak yapay zekâ teknolojilerini doğru stratejilerle benimsersek, enerji, hukuk, finans ve kamu hizmetleri gibi kritik alanlarda sektörel yapay zekâ çözümleri geliştirme yolunda önemli bir atılım gerçekleştirebiliriz.

DeepSeek’in bizim gibi gelişmekte olan ülkeler için getirdiği en büyük avantaj, yapay zekâ geliştirme sürecinin demokratikleşmesi oldu. Bugüne kadar, büyük dil modelleri ve yapay zekâ teknolojileri geliştirmek için muazzam sermaye yatırımları, süper bilgisayarlar ve ileri donanım altyapıları gerekiyordu. Bu da yapay zekâ ekosisteminde ABD merkezli teknoloji şirketlerinin hakimiyetine yol açıyordu.

DeepSeek ise üç temel faktörle bu hakimiyetin kırılmasını sağladı:

Maliyet Engellerini Ortadan Kaldırması

DeepSeek’in geliştirdiği model, süper bilgisayarlara ihtiyaç duymadan çalışabiliyor. Geleneksel olarak büyük dil modelleri, NVIDIA’nın pahalı GPU’larına bağımlıydı. Bu, gelişmekte olan ülkeler için büyük bir dezavantajdı çünkü bu donanımlar hem ulaşılması zor hem de aşırı pahalıydı. Ancak DeepSeek, çok daha düşük donanım gereksinimleriyle benzer performans sunarak yapay zekâ geliştirmenin maliyetini dramatik şekilde düşürdü.

Türkiye için anlamı: Kendi büyük dil modellerimizi veya sektörel uzmanlaşmış yapay zekâ sistemlerini çok daha düşük bütçelerle geliştirebiliriz. Örneğin, enerji sektörüne özel yapay zekâ çözümleri oluşturmak için artık milyonlarca dolarlık donanım yatırımlarına gerek kalmadı.

Bilgi Tekelini Kırması ve Açık Kaynak Modeli

DeepSeek, yalnızca modelini ücretsiz sunmakla kalmadı, aynı zamanda tüm kaynak kodlarını ve dokümantasyonunu da paylaştı. Bu, yapay zekâ araştı rmalarında ABD ve Batı ’nın sahip olduğu tekeli kıran bir hamle oldu. OpenAI ve Google gibi şirketler, modellerinin detaylarını ticari sır olarak saklarken, DeepSeek tam şeffaflık sunarak araştırmacılar ve geliştiriciler için devrim niteliğinde bir fırsat yarattı.

Türkiye için anlamı:

- Üniversiteler ve araştırma merkezleri artı k bu teknolojiyi derinlemesine analiz edebilir, geliştirebilir ve özelleştirebilir.

- Özel sektör ve girişimler, DeepSeek’i kendi ihtiyaçlarına göre optimize edip farklı endüstrilere uyarlayabilir.

- Regülasyon ve kamu kurumları, yapay zekâ tabanlı hukuk ve enerji çözümlerini bağımsız olarak geliştirme şansına sahip olabilir.

Enerji ve Veri Maliyetlerini Azaltması

Yapay zekâ modellerinin çalıştırılması, özellikle de büyük dil modellerinin kullanımı, aşırı enerji tüketimi gerektiriyor. Örneğin, OpenAI’nin ChatGPT’sini çalıştırmak için devasa veri merkezleri gerekiyor ve bu, yüksek elektrik tüketimi ve karbon ayak izi anlamına geliyor. DeepSeek, daha verimli ve düşük güç tüketimli bir model geliştirdiği için, gelişmekte olan ülkelerin yüksek enerji faturalarına maruz kalmadan yapay zekâ kullanmasını mümkün hale getiriyor.

Türkiye için anlamı:

- Yapay zekâ çözümlerini büyük veri merkezlerine bağımlı olmadan, daha küçük ölçekli sunucular ve yerel altyapılarla çalıştırabiliriz.

- Kamu ve özel sektör, daha düşük enerji tüketimi ile yapay zekâ çözümleri geliştirebilir, böylece hem maliyetleri hem de çevresel etkiyi azaltabilir.

Bu gelişmeler, yapay zekâ eğitiminin doğasını da kökten değiştiriyor. Geleneksel olarak büyük dil modellerinin eğitimi, yüksek maliyetli donanımlar, devasa veri kümeleri ve uzun süren hesaplama süreçleri gerektiriyordu. Ancak DeepSeek’in sunduğu alternatif, daha düşük maliyetle ve daha az enerji tüketerek yapay zekâ modelleri geliştirmeyi mümkün kılıyor. Bu da Türkiye gibi gelişmekte olan ülkeler için kendi alanlarına özgü yapay zekâ çözümleri üretme şansını artırıyor.

Peki, LLM’ler Nasıl Eğitilir?

Veri Toplama: Modelin Öğreneceği Bilginin Belirlenmesi

Her büyük dil modelinin başarısı, hangi veriyle eğitildiğine bağlıdır. Modelin doğru ve güvenilir yanıtlar üretebilmesi için geniş ve çeşitli veri kümelerine ihtiyacı vardır.

Genel amaçlı bir dil modeli için veri kaynakları:

- Kitaplar

- Akademik makaleler

- Web siteleri

- Teknik belgeler

- Diyalog verileri (forumlar, sohbetler vb.)

Özel amaçlı bir model için veri kaynakları:

Enerji Mevzuatı Örneği: Enerji sektörüne özel bir LLM eğitilecekse:

- Ulusal ve uluslararası enerji mevzuatları

- Enerji Piyasası Düzenleme Kurumu (EPDK) raporları

- Mahkeme kararları ve sektör düzenlemeleri

- Şirket içi teknik dokümanlar

DeepSeek ile Gelen Değişim:

DeepSeek, geliştirilmesi için devasa veri kümelerine bağımlı olmayan bir model sundu. Geleneksel modeller trilyonlarca kelimelik veri setlerine ihtiyaç duyarken, DeepSeek daha az veriden öğrenme yeteneğiyle dikkat çekiyor. Bu, Türkiye gibi ülkelerin büyük miktarda veriye erişim problemi olmadan da kendi özel LLM’lerini eğitebileceği anlamına geliyor.

Veri Önişleme: Kaliteli Girdi, Kaliteli Çıktı Demektir

Toplanan veriler, modelin eğitimi için ön işleme (preprocessing) sürecinden geçirilir. Bu süreç, verinin temizlenmesini, gereksiz bilgilerin ayıklanmasını ve makine öğrenmesine uygun hale getirilmesini içerir.

Veri önişleme adımları:

- Yazım hatalarının düzeltilmesi

- Gereksiz içeriklerin kaldırılması (reklamlar, yinelenen veriler vb.)

- Verilerin standart bir formata dönüştürülmesi

- Sayısal vektörlere çevrilmesi (Tokenization)

Enerji Mevzuatı Örneği: Türkiye’de enerji mevzuatına yönelik bir chatbot geliştirilirken, EPDK mevzuatları ve ilgili yasal dokümanlar temizlenip, yapısal hale getirilerek modele beslenmelidir.

DeepSeek ile Gelen Değişim:

DeepSeek’in en büyük avantajlarından biri, öğrenme sürecini daha verimli hale getirmesi. Geleneksel LLM’ler daha fazla veriyle eğitilmek zorundayken, DeepSeek daha az veriden daha doğru sonuç üretebiliyor. Bu, Türkiye gibi ülkeler için veri toplama ve işleme maliyetlerinin düşmesi anlamına geliyor.

Modelin Temel Eğitimi: Dilin Kurallarını Öğrenme Süreci

Bu aşamada model, geniş kapsamlı bir veri seti üzerinde eğitilerek dilin temel yapılarını, kelimeler arasındaki ilişkileri ve bağlamsal anlamı öğrenir.

Eğitim sürecinde kullanılan teknikler:

Transformer Mimarisi: Kelimeler arasındaki ilişkiyi belirlemek için self-attention mekanizması kullanılır.

Paralel Hesaplama: Modelin daha hızlı öğrenmesi için çok çekirdekli işlemciler ve GPU’lar kullanılır.

Enerji Mevzuatı Örneği: Genel dil yapısını öğrenen model, enerji mevzuatına özgü terminolojiye adapte edilebilmesi için ikinci bir eğitim aşamasına geçer.

DeepSeek ile Gelen Değişim:

DeepSeek, geleneksel büyük dil modellerine kıyasla daha az donanım gereksinimiyle benzer veya daha üstün performans sergileyebiliyor. Bu, gelişmekte olan ülkeler için yüksek maliyetli süper bilgisayar ihtiyacının ortadan kalkması demek. Türkiye gibi ülkeler yerel altyapılarla bile kendi yapay zekâ çözümlerini üretebilir.

İnce Ayar (Fine-Tuning): Modeli Özelleştirme

LLM’lerin en güçlü yönlerinden biri, belirli bir alana özgü olarak özelleştirilebilmesidir.

İnce Ayar Süreci: Model, konuya özgü verilerle tekrar eğitilir. Kullanıcıların sıkça sorduğu sorulara yönelik optimizasyon yapılır.

Enerji Mevzuatı Örneği: Model, enerji tarifeleri, yenilenebilir enerji teşvikleri, lisanslama süreçleri ve tüketici hakları gibi konulara odaklanarak ince ayar yapılır.

DeepSeek ile Gelen Değişim:

DeepSeek’in getirdiği verimli öğrenme modeli, daha az veriyle daha etkili ince ayar yapılmasını sağlıyor. Bu, Türkiye gibi ülkeler için yerel mevzuat veya sektör bilgileriyle kolayca özelleştirilebilen yapay zekâ çözümlerinin önünü açıyor.

Test ve Geliştirme: Gerçek Kullanıcı Verisiyle Modeli Optimize Etmek

Modelin eğitimi tamamlandıktan sonra, gerçek kullanıcı verileri veya simüle edilmiş senaryolar üzerinden test edilmesi gerekmektedir.

Test sürecinde yapılanlar: Modelin doğru yanıt verip vermediği kontrol edilir. Yanlış veya eksik yanıtlar düzeltilerek model tekrar eğitilir.

Enerji Mevzuatı Örneği: Chatbot’un “Yenilenebilir enerji teşvikleri nelerdir?” veya “Enerji lisansı başvurusu nasıl yapılır?” gibi sorulara verdiği yanıtlar test edilerek doğruluğu artırılır.

DeepSeek ile Gelen Değişim:

DeepSeek’in açık kaynak olması, test sürecinin daha geniş katılımla yapılmasını sağlıyor. Bu sayede topluluk katkısıyla hızlı gelişen modeller ortaya çıkabilir.

Sonuç: Türkiye İçin Büyük Bir Fırsat

DeepSeek’in getirdiği yeniliklerle birlikte LLM eğitimi artık daha az maliyetli, daha erişilebilir ve daha verimli hale geliyor. Türkiye’nin bu teknolojiyi doğru stratejilerle benimsemesi, enerji ve kamu hizmetleri gibi kritik alanlarda sektörel yapay zekâ çözümleri geliştirmesi için büyük bir fırsat sunuyor. Artık yüksek bütçelere ve süper bilgisayarlara bağımlı olmadan, Türkiye kendi yapay zekâ ekosistemini inşa edebilir. Eğer bu fırsatı değerlendirebilirsek, yapay zekâda küresel rekabette söz sahibi olabiliriz.

SON HABERLER

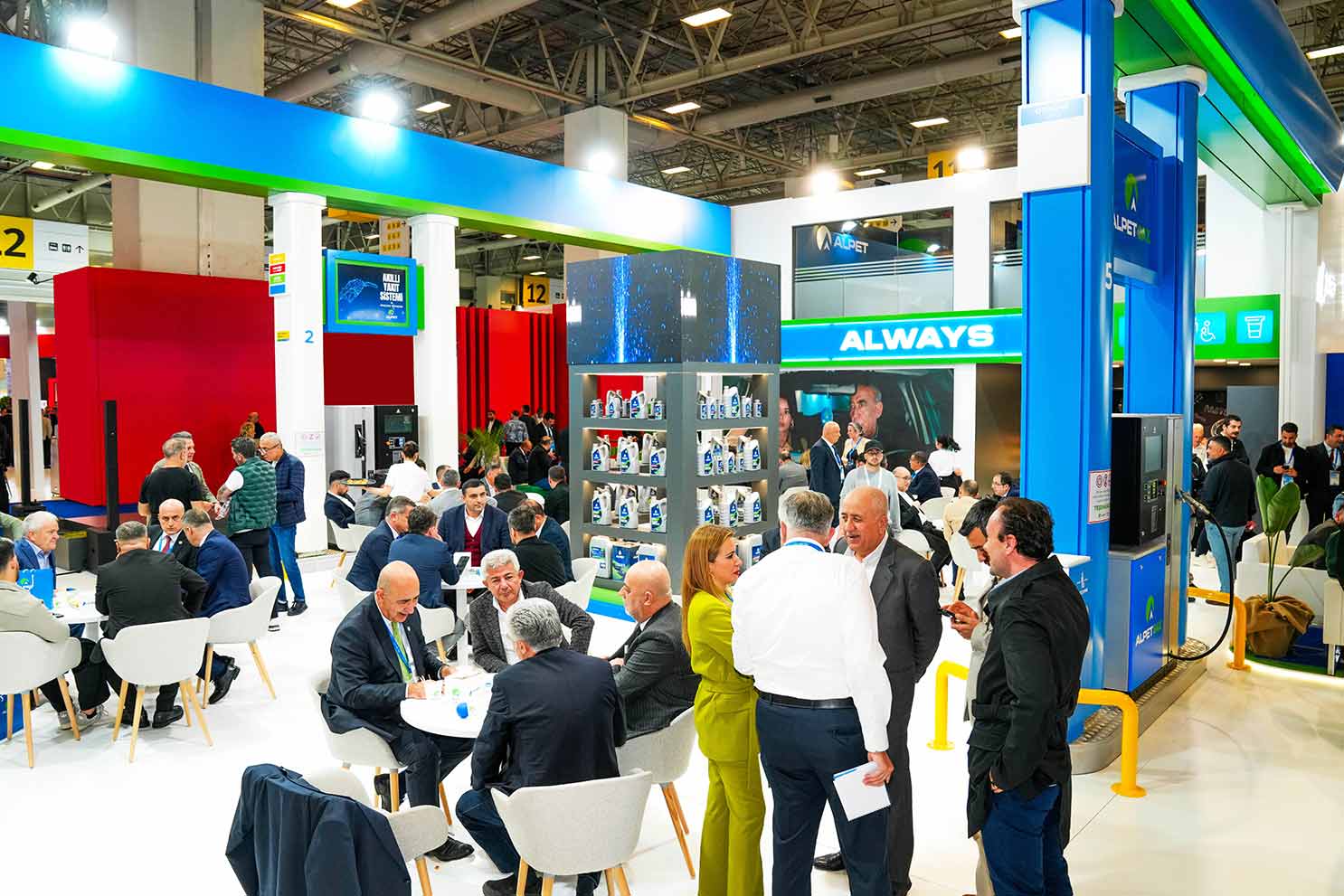

Cumhurbaşkanı Erdoğan, COP29 Dünya Liderleri İklim Zirvesi’nde konuştu12 Kasım 202416:07 Adana’daki iki maden sahası için ihale düzenlenecek12 Kasım 202409:14 Akaryakıt sektörünün sorunlarına Büyük Bayi Buluşması’nda çözüm arandı20 Mayıs 202517:17 Safi Port ve Safi Çimento Bayi Lounge, Petroleum Istanbul’da bayilerin beğenisini kazandı20 Mayıs 202516:58 Alpet, Petroleum Istanbul’da yeni nesil hizmetlerini tanıttı20 Mayıs 202516:50 Aytemiz, Petroleum Istanbul Fuarı’nda ürün ve hizmetleriyle dikkat çekti20 Mayıs 202516:43 GüzelEnerji, Petroleum Istanbul Fuarı’nda gelecek vizyonunu sergiledi20 Mayıs 202515:59

Diğer Haberler